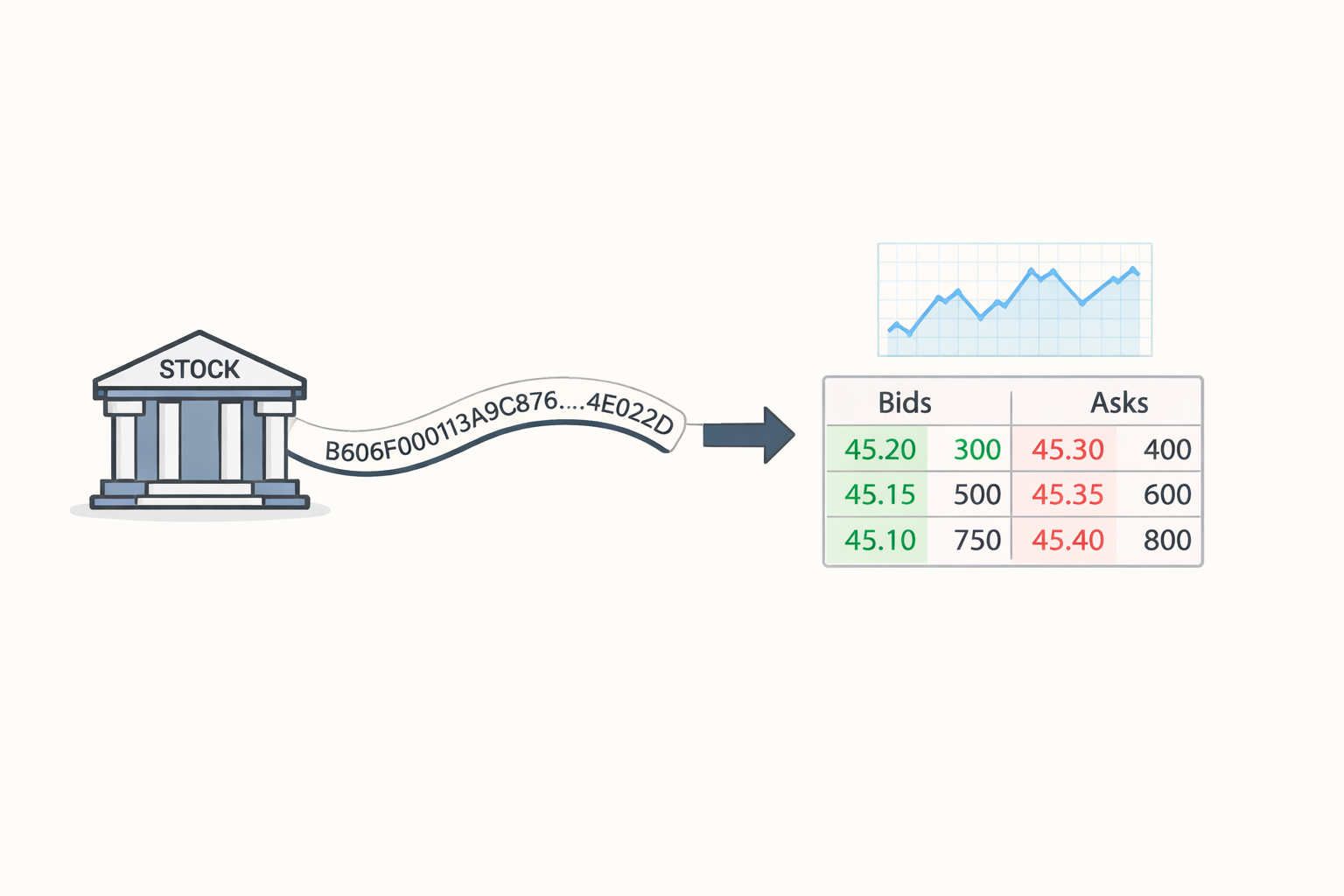

(데이터분석 4) 매매 시스템 호가 피쳐 - OBI, Microprice, TFI 수식

퀀트 트레이딩 기본 피쳐 정리 - 호가불균형(OBI), Microprice, 체결강도(TFI)의 수식과 계산 방법. log/logistic transformation을 이용한 피쳐 엔지니어링 확장 방법도 다룹니다.

퀀트 트레이딩 기본 피쳐 정리 - 호가불균형(OBI), Microprice, 체결강도(TFI)의 수식과 계산 방법. log/logistic transformation을 이용한 피쳐 엔지니어링 확장 방법도 다룹니다.

호가창 분석의 핵심 피쳐 OFI(Order Flow Imbalance) - 매수/매도 압력을 하나의 값으로 수치화하는 방법. 논문 기반 수식 유도와 EWMS 적용까지 퀀트 트레이딩 실무 관점에서 설명합니다.

퀀트 트레이딩 피쳐 정규화 가이드. Rolling z-score가 알고리즘 매매의 표준인 이유, EWMA로 메모리 O(1) 구현, min-max를 쓰면 안 되는 이유, 분모가 0에 가까워지는 문제의 실무적 해결법을 다룹니다.

퀀트 트레이딩의 기본 도구 EWMA(지수가중이동평균) - 메모리 O(1)로 이동평균을 계산하고, 반감기(half-life)로 틱데이터 같은 불규칙 간격 금융 시계열을 처리하는 방법을 수학적으로 설명합니다.

Core Affinity만으로는 부족합니다. isolcpus로 OS 스케줄러의 간섭을 차단하고 스레드를 전용 코어에서 실행하는 방법을 알아봅니다.

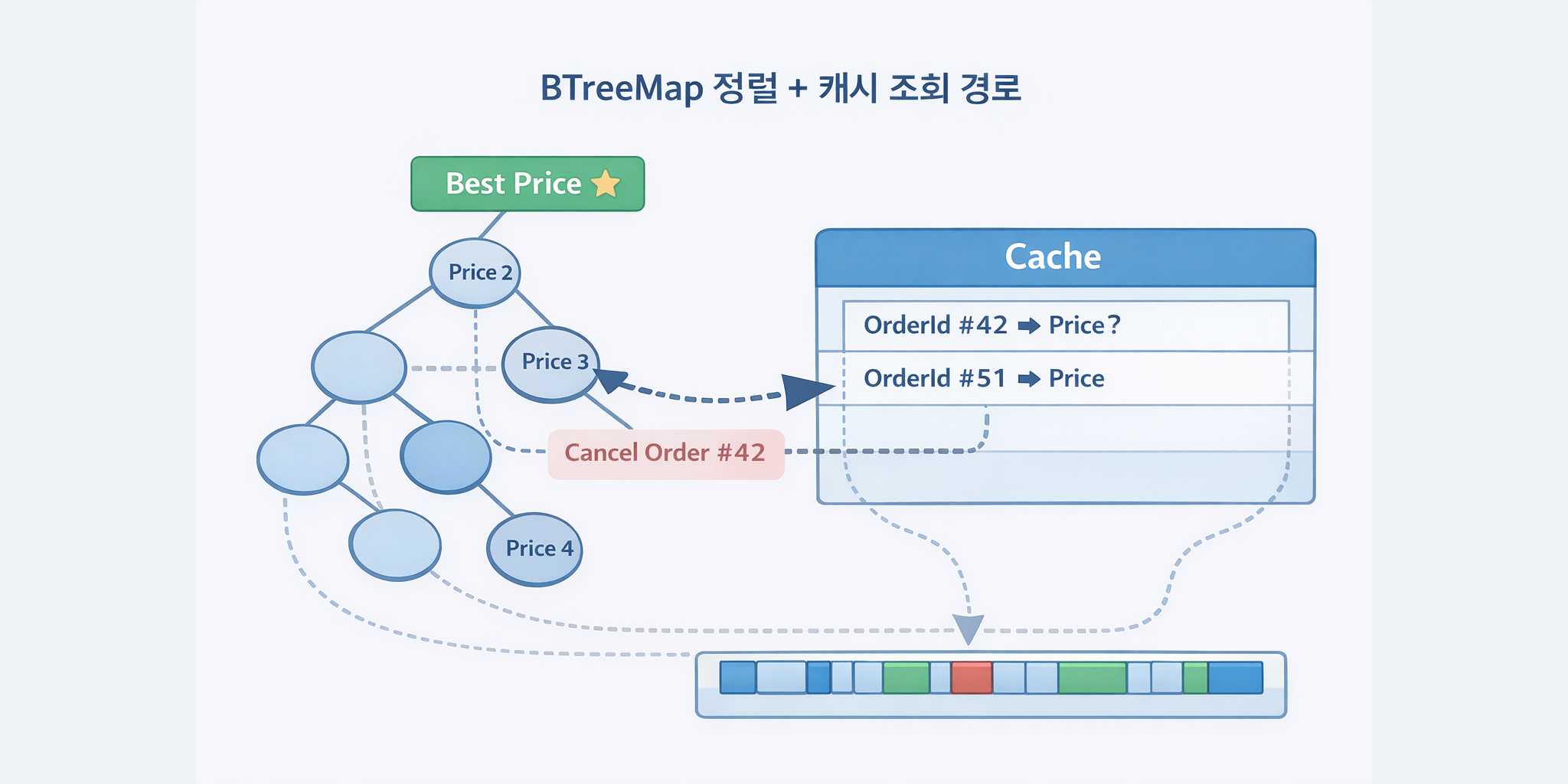

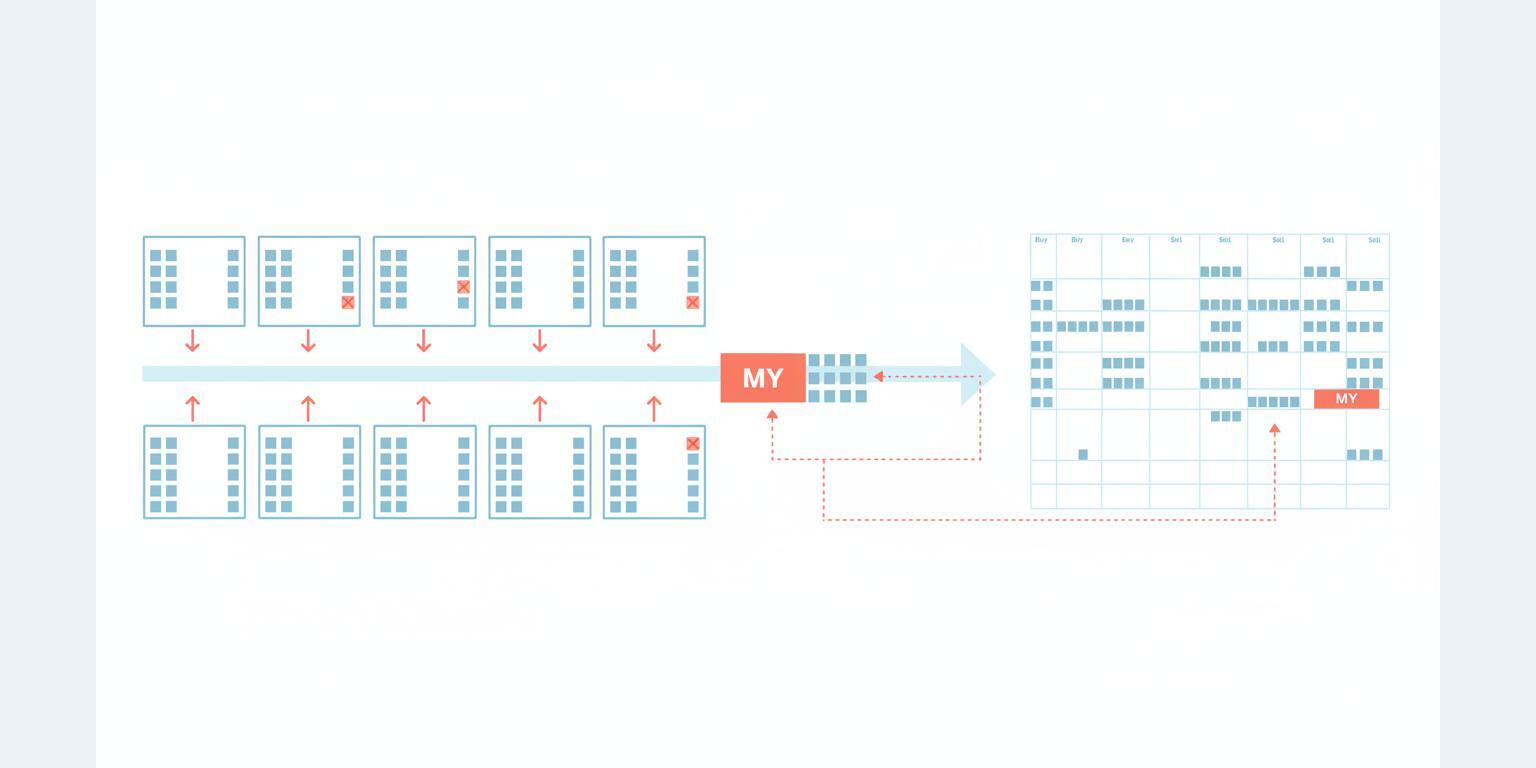

오더북 자료구조 구현 가이드 - Rust 기반 BTreeMap과 HashMap 조합으로 가격 레벨을 관리하고, 매칭 엔진에 필요한 O(1) 주문 조회와 O(log N) 가격 탐색을 모두 확보하는 방법을 다룹니다.

단순 호가창(snapshot)이 아닌 주문 단위 오더북이 왜 필요한지, 주문 추적과 백테스트 관점에서 설명합니다.

컴파일 타임 로그 레벨 필터링, 클로저 기반 지연 평가, 전용 로거 스레드로 트레이딩 시스템의 로깅 오버헤드를 최소화합니다.

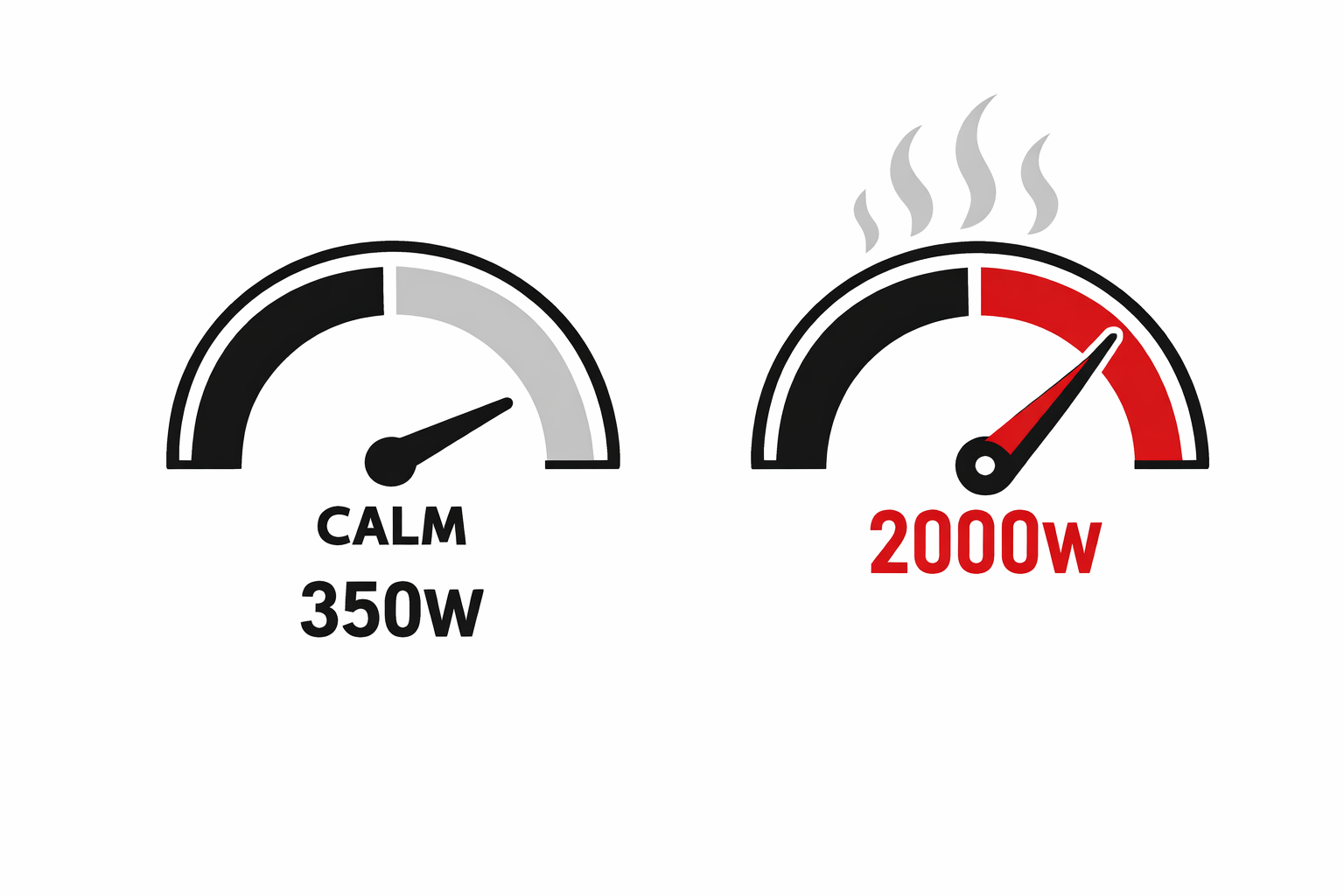

HFT를 위한 오버클럭 서버가 무엇인지, 왜 필요한지, 주요 업체는 어디인지 알아봅니다. Xenon, Blackcore, Aravision 제품과 일반 워크스테이션 CPU와의 차이를 비교합니다.

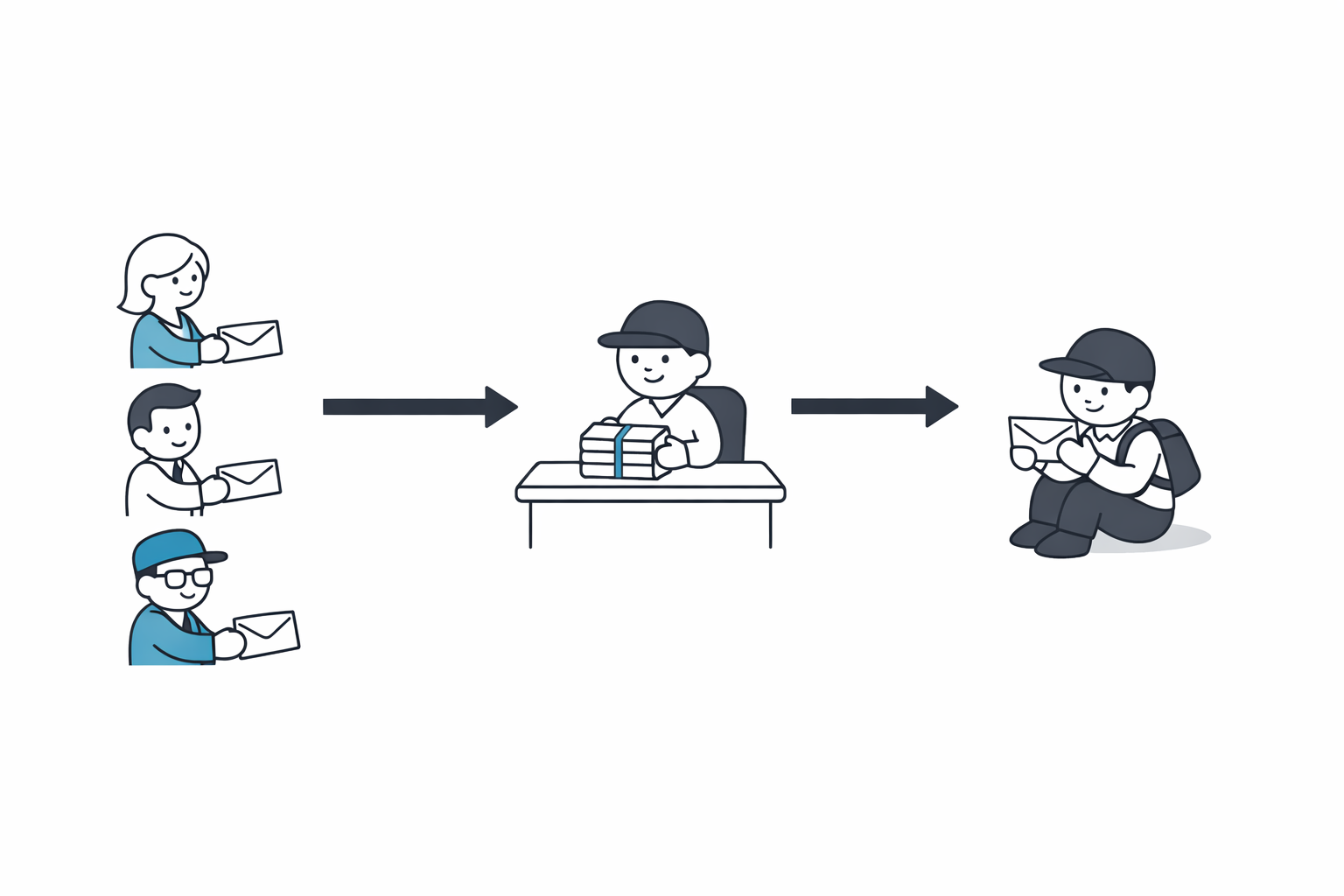

한국거래소(KRX) 시세 수신 가이드 - 코스콤 MDCS 가입 절차, 접속표준서 확인, UDP 멀티캐스트 수신, 파생상품 호가 메시지 파싱까지 실무에서 필요한 과정을 정리합니다.